在线存在在当今世界几乎无处不在。 一切都可以在线获得 - 甚至是关于在哪里可以找到最好的产品的信息 - 所以。 人们倾向于在去商店之前先上网看看。 尽管报纸、杂志、电视、广播和广告牌仍然可以说是必要的,但它们已经不够了。 仅靠良好的营销策略已不足以在竞争中保持领先地位。

从布局到内容,您的网站必须优于您的竞争对手。 如果您不这样做,您的公司将变得默默无闻——这对业务不利。 SEO(搜索引擎优化)符合这个概念。 你可以增加你的 使用 SEO 工具的在线可见性 和技巧。 它从关键字、反向链接和图像开始,包括布局和分类(可用性)。 网站爬虫就是这些工具之一。

网络爬虫定义

所有搜索引擎都使用蜘蛛、机器人或蜘蛛爬虫。 网站爬虫扫描网站、阅读内容(和其他信息),以便搜索引擎可以将它们编入索引。 网站所有者通常会提交新的或最近修改过的页面和网站来更新搜索引擎索引。

网络爬虫读取内部链接和反向链接以确定站点的完整范围,一个接一个地爬取每个页面。 也可以将爬虫配置为只读取特定页面。 网站爬虫 定期更新搜索引擎索引。 网站爬虫无法不受限制地访问网站。 SRE 中的爬虫必须遵循“礼貌规则”。 搜索引擎使用来自服务器的信息来排除文件。 爬虫无法绕过带有 SRE 防火墙的防火墙。

最后但同样重要的是,SRE 要求爬虫使用专门的算法。 爬虫创建运算符和关键字的搜索字符串,以构建网站和页面的搜索引擎索引。 还指示爬虫在连续的服务器请求之间等待,以避免对真实访问者(人类)的站点速度产生负面影响。

网站爬虫的好处

搜索引擎使用索引来创建搜索引擎结果页面。 如果没有这个索引,结果会明显变慢。 每次个人使用搜索引擎时,搜索引擎都必须检查与搜索词关联的每个网站和页面(或其他数据)。 理想情况下,结果的呈现方式应首先呈现最相关的信息,例如内部链接、反向链接等。

如果您在没有网站爬虫的情况下在搜索栏工具中键入查询,搜索引擎将需要几分钟(甚至几小时)才能返回结果。 用户从中受益,但网站所有者和管理者呢?

利用上述算法,网站爬虫从网站上收集上述信息,建立搜索字符串数据库。 它们是包含关键字和运算符的搜索字符串(并且按 IP 地址进行备份)。 为了确保公平(但相关)的机会,该数据库被上传到搜索引擎索引。

爬虫可以审查商业网站,并根据其内容相关性将其包含在 SERP 中。 使用该工具还可以提高您的 SEO 排名。 在不影响当前搜索引擎排名的情况下,定期更新的网站(和页面)更有可能在网上被发现。

19 种用于高效数据提取的最佳网络爬虫工具

为了帮助您选择最适合您需要的工具,我们编制了一份包含 19 种最佳网络爬虫工具的列表。

1.爬网基地

匿名抓取和抓取网站 爬虫库。 Crawlbase 的可用用户指南使那些没有技术技能的人也可以轻松使用。您可以从大大小小的来源中抓取数据。 Crawlbase 可以支持广泛的网站和平台。该工具是寻求在线高质量数据和匿名性的爬虫的首选。

使用 Crawlbase,您可以在没有服务器或基础设施的情况下抓取和抓取网站。 抓取 API 可以在几分钟内整理来自 LinkedIn、Facebook、Yahoo、Google、Instagram 和 Amazon 的数据。 当您注册为新用户时,您将获得 1,000 个免费请求。 解析验证码时不会阻止用户。

借助 Crawlbase Crawling API,用户可以使用其友好的用户界面轻松方便地从动态站点中提取数据。 该软件确保超安全和安全的网络爬行。 爬虫和爬虫使用这种方法保持匿名。 除了 IP 泄漏、代理故障、浏览器崩溃、CAPTCHA、网站禁令和 IP 泄漏之外,爬虫还有其他几种安全措施。

2. DYNO 映射器

DYNO 映射器 强烈关注站点地图创建(它让爬虫确定它可以访问哪些页面)。 您可以通过输入任何站点的 URL(统一资源定位符)(例如 www.example.com).

使用三个包,您可以扫描不同数量的页面和项目(站点)。 如果您需要监控您的站点和一些竞争对手,我们的标准包适合您。 建议高等教育和大公司使用组织或企业包。

3。 尖叫的青蛙

许多 SEO 工具可从 尖叫的青蛙,他们的 SEO Spider 是最好的之一。 此工具将显示损坏的链接、临时重定向以及您的网站需要改进的地方。 要充分利用 Screaming Frog SEO Spider,您需要升级到其付费版本。

免费版本具有有限的页面(取决于内存)以及专业版本中未包含的其他功能。免费的技术团队支持 Google Analytics 集成和抓取配置。许多 SEO 自由职业者 Upwork 或 Fiverr 使用尖叫青蛙的服务,一些世界上最大的网站,包括苹果、迪士尼和谷歌也使用它。他们定期出现在顶级 SEO 博客中有助于推广他们的 SEO Spider。

4. 卢玛

尽管 鲁马尔 声称它们不是“一刀切”的工具,它们提供了多种可以根据您的要求组合或分离的解决方案。 实现这一目标的几种方法包括定期抓取您的网站(可以自动进行)、从 Panda 和(或)Penguin 惩罚中恢复,以及将您的网站与竞争对手进行比较。

5.阿皮菲

阿皮菲 从网站中提取站点地图和数据,快速为您提供可读的格式(它声称它可以在几秒钟内完成,至少可以说这是非常令人印象深刻的)。

您可以使用此工具改进/重建您的网站,尤其是在您监控竞争对手的情况下。 Apify 提供工具来帮助每个人使用该工具,即使它们是面向开发人员的(该软件需要一些 JavaScript知识). 您可以直接从浏览器使用该软件,因为它是基于云的。 不需要插件或工具,因为它是基于云的。

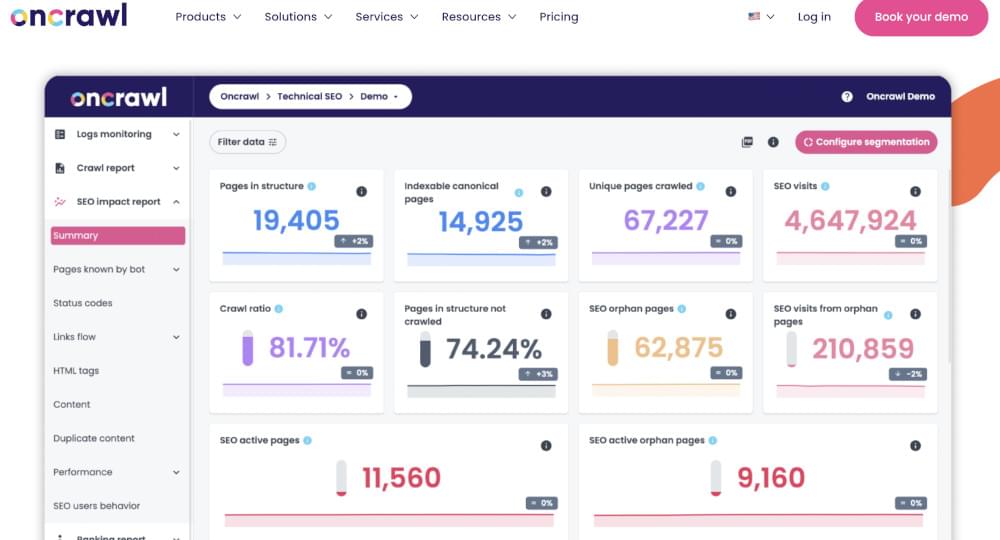

6. 爬行

使用语义数据算法和日常监控, 爬行 可以阅读整个网站,而谷歌只了解一部分。 SEO 审计作为服务的一部分提供,它可以帮助您针对搜索引擎优化您的网站并确定哪些有效,哪些无效。

通过跟踪您的搜索引擎优化和可用性,您将了解您的流量(访问者数量)受到的影响。 使用 OnCrawl,您将能够看到 Google 使用其抓取工具读取您的站点的能力如何,并且您将能够控制读取哪些内容以及不读取哪些内容。

7. 野切

使用 能切里 网络爬虫,Ruby 开发人员可以高效地处理 XML 和 HTML。 使用其 API,您可以简单直观地阅读、编辑、更新和查询文档。 为了速度和标准合规性 (Java),它使用本机解析器,例如 libxml2 (C)。

8. NetSpeak 蜘蛛

运用 网语蜘蛛,您可以执行日常 SEO 审核、快速发现错误、进行系统分析和抓取网站。 有效使用 RAM,此网络爬虫工具分析大型网站(数百万页)。 CSV 文件可以很容易地从网络抓取中导出和导入。

可以使用 Netpeak Spider 的四种搜索类型来抓取电子邮件、姓名和其他信息:“包含”、“RegExp”、“CSS 选择器”或“XPath”。

9. 打开搜索服务器

该解决方案是一体化的,同时功能极其强大。 这 打开搜索服务器 是一个免费的开源网络爬虫和搜索引擎,可用于抓取网络。 选择此选项有很多优点。

网上对OpenSearchServer的评价很高; 它是最受欢迎的在线评论之一。 您可以创建索引方法并使用它访问全面的搜索功能。

10. 氦刮刀

设计 网络抓取 视觉上, 氦气刮刀 在被抓取的数据片段之间的相关性最小的情况下表现出色。 无需编码或设置。 它可能会满足基本的爬行需求。 也可以在线下载模板,满足特定的爬取需求。

11.GNU Wget

文件检索软件如 GNU Wget 可以通过 HTTP、HTTPS、FTP 和 FTPS 网络检索文件。

该工具的独特功能之一是能够生成基于 NLS 的各种语言的消息文件。 除了转换绝对链接外,它还可以在下载的文档中创建相对链接。

12. 80条腿

基于每个人都应该可以访问网络数据的前提, 80条腿 成立于2009年,公司最初专门为众多客户提供网络爬虫服务。 随着客户群的增长,他们开发了一个可扩展的产品化平台,允许用户构建和运行他们的网络爬虫。

13. 导入.io

运用 导入,您可以轻松地自动抓取在线数据并将其集成到您的应用程序或网站中。 您无需使用 Import.io 编写一行代码即可轻松抓取数百万网页。 公共 API 可以以编程方式控制 Import.io 并以自动方式访问数据。

14.韦伯茨

多亏了涵盖广泛来源的众多过滤器, 韦伯茨 爬虫是一款出色的爬取数据和提取各种语言和领域关键词的工具。

用户还可以访问存档中的数据。 Webz 爬取数据的结果总共可以支持 80 种语言。 用户还可以搜索和索引 Webz 爬取的结构化数据。 抓取的数据集也可以导出为 XML、JSON 或 RSS 格式。

15. 诺尔科内克斯

诺科内克斯 具有多种网络爬虫功能,如果您正在寻找开源爬虫,可以将其用于商业目的。 Norconex 能够抓取任何网络材料。 如果需要,您可以将这个功能齐全的收集器集成到您的应用程序中或单独使用。

这个网络爬虫工具可以在单个平均容量的服务器上爬取数百万个页面。 此外,它还提供了多种用于处理元数据和内容的工具。 除了从页面抓取特色图像外,它还可以抓取背景图像。 它与任何操作系统兼容。

16. 德克西.io

德西,您可以使用对您的浏览器透明的网络爬虫工具从任何网站抓取数据。 要创建抓取任务,您可以使用三个机器人之一:Extractor、Crawler 和 Pipelines。

您可以直接通过 Dexi.io 的服务器将提取的数据导出为 JSON 或 CSV 文件,或者在存档之前将其存储在其服务器上两周。 您的实时数据需求可以通过其付费服务得到满足。

17. 齐特

合特 帮助成千上万的开发人员使用其基于云的数据提取工具获取有用的信息。 无需编码知识即可使用此开源工具进行视觉抓取。

该工具还具有代理轮转器,使用户能够轻松抓取大型网站或受机器人保护的网站,而不会被机器人反制措施捕获。 可以使用简单的 HTTP API 从多个 IP 地址和区域设置进行抓取,而无需维护代理服务器。

18.阿帕奇纳奇

这点毋庸置疑 阿帕奇纳奇 是可用的最好的开源网络爬虫之一。 Apache Nutch 网络数据提取软件项目是一个基于开源代码的高度可扩展和灵活的数据挖掘项目。

Apache Nutch 工具包被全球数百名用户使用,包括数据分析师、科学家和开发人员以及网络文本挖掘专家。 Apache Nutch 应用程序是基于 Java 的跨平台应用程序。 Nutch 的强大之处在于它能够同时在多个系统上运行,但它在 Hadoop 集群中使用时最为强大。

19.解析中心

除了是一个伟大的网络爬虫, 解析中心 还可以从依赖 AJAX、JavaScript、cookie 和其他技术的网站收集数据。 该技术使用机器学习读取、评估 Web 内容并将其转换为有用的信息。

除了 Windows 和 Mac OS X 之外,ParseHub 还有一个可以在 Linux 上运行的桌面应用程序。 该浏览器还集成了一个网络应用程序。 您可以在 ParseHub 上创建的免费软件项目的数量限制为五个。 可以设置至少 20 个付费会员级别的抓取项目。

结论

多年来,它一直在信息系统中用于抓取 Web 数据。 由于手动复制和粘贴数据并非始终可行,因此数据爬取是一项无价的技术,尤其是在处理大型数据集时。

公司和开发人员可以使用匿名方式抓取网站 爬虫库。借助可用的用户指南,无需技术技能也可以有效地使用 Crawlbase。可以对任何数据源(无论大小)执行爬网。爬行基地 网络爬虫 功能使其成为上面列表中的顶级工具。它支持多个平台和网站。

识别趋势和 分析数据 是什么使它在爬网网站中有价值。 探索、重组和排序数据需要将其提取到数据库中。 使用数据爬行来抓取网站最好由具有独特技能和专业知识的人完成。