在这篇博文中,我们将构建一个 Reddit Scraper,用于使用 Python 从 Reddit 中提取数据,重点是使用 Crawlbase Crawling API 从 Reddit 获取重要信息。 如果您想知道如何收集 Reddit 数据进行分析或研究,那么您来对地方了。 我们将引导您完成构建 Reddit Scraper 的步骤,因此无论您是新手还是经验丰富的人,它都会很容易理解。

直接进入 Reddit 抓取步骤, 点击这里.

或者如果您想要视频教程,这里是:

了解 Reddit 数据

Reddit 就像一个包含各种内容的大集合——帖子、评论等等。 这是查找爬取数据的好地方,尤其是在使用 Reddit Scraper 时。 在开始抓取 Reddit 之前,了解那里有哪些类型的数据并弄清楚您到底想要删除什么非常重要。

可用于抓取 Reddit 的数据类型:

- 帖子和评论: 这些是人们在 Reddit 上分享和讨论的内容。 他们会告诉你很多有趣的事情或趋势。 例如,80% 的 Reddit 活动涉及帖子和评论。

- 用户资料: 从用户个人资料中获取信息可以帮助您了解人们喜欢什么、做过什么以及他们如何属于不同的群体。 52 年,Reddit 上有 2022 万活跃用户。

- 赞成票和反对票: 这显示了人们喜欢或不喜欢帖子和评论的程度,让您了解什么是流行的。 Reddit 上互动的 60% 都是点赞。

- 子版块信息: 每个 Reddit 子版块就像一个小社区。 获取 Reddit 子版块的信息可以帮助您了解每个组的不同之处。如果您使用 Reddit Scraper,您可以收集有关各个 Reddit 子版块特征的宝贵见解。

- 时间戳记: 了解帖子和评论何时发生有助于跟踪趋势以及用户在不同时间的活跃程度。使用 Reddit Scraper 时,时间戳数据对于分析一段时间内的用户活动模式特别有用。

识别提取的目标数据:

- 定义你的目的: 弄清楚为什么您需要 Reddit Scraper。 您是否正在寻找趋势、用户的行为或某些主题的详细信息?

- 选择相关子版块: 选择您感兴趣的 Reddit 特定部分。这可以帮助您获取对您真正重要的数据。

- 指定时间范围: 确定您需要最近的信息还是过去的数据。 设定时间范围可以帮助您专注于您需要的事情。

- 考虑用户交互: 考虑一下您想了解哪种互动,例如哪些帖子受欢迎、用户如何参与或人们在评论中说了些什么。

了解 Reddit 拥有哪些数据并决定您想要获取什么数据是智能抓取和获取所需信息的第一步。

抓取 Reddit 数据:分步指南

设置环境

要在 Crawlbase 上创建免费帐户并接收您的私人令牌,只需转到您的帐户文档部分 爬网仪表板.

请按照以下步骤安装 Crawlbase Python 库:

- 确保您的计算机上安装了 Python。 如果没有,您可以从Python官方网站下载并安装。

- 确认已安装 Python 后,打开终端并运行以下命令:

pip install crawlbase

- 此命令将在您的系统上下载并安装 Crawlbase Python 库,使其为您的网页抓取项目做好准备。

- 要创建名为“reddit-scraper.py”的文件,您可以使用文本编辑器或集成开发环境 (IDE)。 以下是使用标准命令行方法创建文件的方法:

- 运行以下命令:

touch reddit-scraper.py

- 执行此命令将在指定目录中生成一个空的 reddit-scraper.py 文件。 然后,您可以使用您喜欢的文本编辑器打开此文件,并添加用于网页抓取的 Python 代码。

使用 Crawling API 获取 HTML

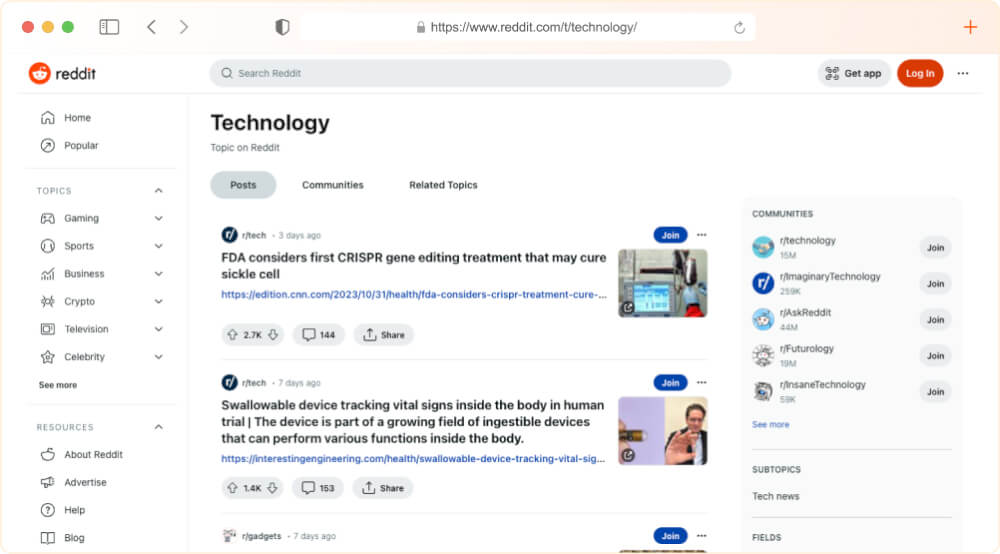

获得 API 凭据后,安装 Crawlbase Python 库,并创建了一个名为 reddit-scraper.py 的文件,选择要抓取的 Reddit 帖子页面。 在本例中,我们选择了包含最佳技术帖子的 Reddit 页面。

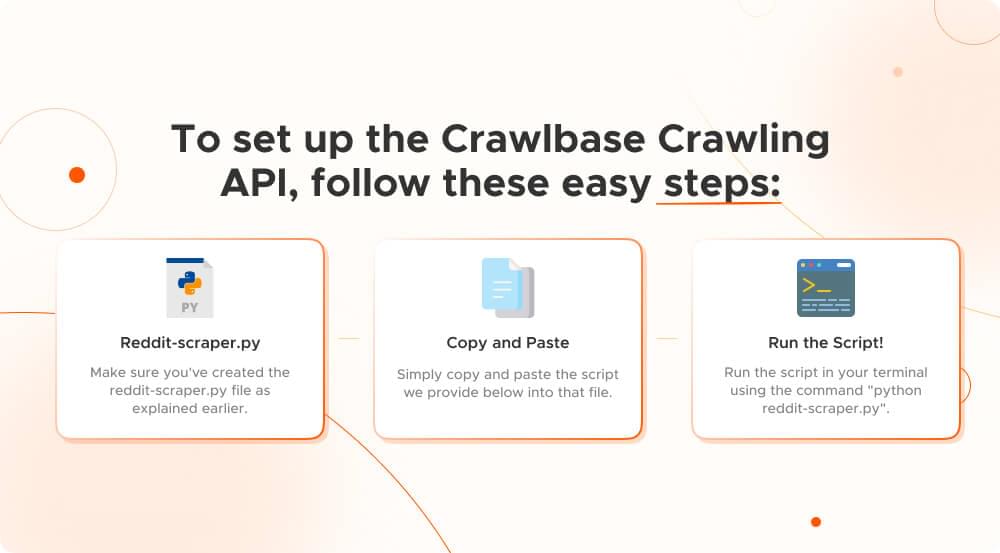

要设置 Crawlbase 爬取 API,请按照以下简单步骤操作:

- 确保您已按照前面的说明创建了 reddit-scraper.py 文件。

- 只需将我们在下面提供的脚本复制并粘贴到该文件中即可。

- 使用命令“python reddit-scraper.py”在终端中运行脚本。

1 | 止 爬行基地 进口 抓取API |

上面的代码指导您使用 Crawlbase 的 Crawling API 从 Reddit 帖子页面收集信息。 您必须安排 API 令牌,指定您想要抓取的 Reddit 页面 URL,然后发出 GET 请求。 当您执行此代码时,它将在您的终端上显示 Reddit 页面的基本 HTML 内容。

使用爬取 API 参数抓取有意义的数据

在前面的示例中,我们了解了如何获取 Reddit 帖子页面的基本结构。 然而,大多数时候,我们需要的不仅仅是基本代码; 我们需要网页上的具体详细信息。 好消息是 Crawlbase 爬行 API 有一个 特殊参数 称为“自动解析”,可以轻松地从 Reddit 页面中提取关键详细信息。 要使用此功能,您需要在使用 Crawling API 时包含“autoparse”。 此功能简化了以 JSON 格式收集最重要信息的过程。 为此,您需要对 reddit-scraper.py 文件进行一些更改。 让我们看一下下一个示例,看看它是如何工作的。

1 | 止 爬行基地 进口 抓取API |

JSON 响应:

1 | { |

处理速率限制和错误

了解 Reddit 和 Crawlbase 的速率限制

- Reddit API 速率限制

- Reddit API限速政策说明

- 不同类型请求的不同速率限制(例如,读取与写入操作)

- 如何检查您的应用程序的当前速率限制状态

- Crawlbase 抓取 API 速率限制

- Crawlbase 施加的速率限制概述

- 了解基于订阅计划的速率限制

- 监控使用情况和可用配额

在 Python 脚本中实现速率限制处理

- Reddit API 的节奏请求

- 调整请求以遵守速率限制的策略

- 使用 Python 库(例如,

time.sleep())用于有效的速率限制 - 演示正确的速率限制处理的代码示例

- Crawlbase API 速率限制集成

- 在对 Crawlbase API 的请求中合并速率限制检查

- 调整Python脚本以动态调整请求率

- 确保最佳使用而不超出分配的配额

处理常见错误和异常

- Reddit API 错误

- Reddit API 返回的常见错误代码的识别

- 处理 429(请求过多)和 403(禁止)等情况

- 针对特定错误的故障排除和解决技术

- Crawlbase API 错误处理

- 识别 Crawlbase 抓取 API 返回的错误

- 优雅地处理 Python 脚本中的错误的策略

- 有效解决问题的日志记录和调试实践

- 错误处理的一般最佳实践

- 在 Python 脚本中实现健壮的 try- except 块

- 记录执行后分析的错误

- 将自动重试与指数退避策略相结合

数据处理与分析

以适当的格式存储抓取的数据

- 选择数据存储格式

- 常见数据存储格式概述(JSON、CSV、SQLite等)

- 基于数据结构影响存储格式选择的因素

- 高效存储和检索的最佳实践

- 用Python实现数据存储

- 演示如何以不同格式存储数据的代码示例

- 使用Python库(例如json、csv、sqlite3)进行数据持久化

- 处理大型数据集并优化存储效率

清理和预处理 Reddit 数据

- 数据清理技术

- 识别和处理丢失或不一致的数据

- 删除重复条目和不相关信息

- 解决数据质量问题以进行准确分析

- Reddit 数据的预处理步骤

- 文本数据的标记化和文本处理(帖子、评论)

- 处理特殊字符、表情符号和 HTML 标签

- 将时间戳转换为日期时间对象以进行时间分析

使用 Python 库进行基本数据分析

- 用于数据分析的 Pandas 简介

- 用于数据操作和分析的 pandas 库概述

- 将 Reddit 数据加载到 pandas DataFrames 中

- 用于探索和汇总统计的基本 DataFrame 操作

- 使用 Matplotlib 和 Seaborn 分析 Reddit 数据

- 创建可视化以了解数据模式

- 绘制直方图、条形图和散点图

- 定制可视化以有效讲述故事

- 从 Reddit 数据中提取见解

- 对评论和帖子进行情绪分析

- 识别流行话题和趋势

- 提取用户参与度指标以获取更深入的见解

结论

我希望本指南可以帮助您使用 Python 和 Crawlbase Crawling API 有效地抓取 Reddit 数据。 如果您有兴趣将数据提取技能扩展到 Twitter、Facebook 和 Instagram 等其他社交平台,请查看我们的附加指南。

我们知道网络抓取可能很棘手,我们随时为您提供帮助。 如果您需要更多帮助或遇到任何问题,我们的 Crawlbase支持团队 已准备好提供专家帮助。 我们很高兴能够帮助您完成网络抓取项目!

常见问题解答

我可以在不违反 Reddit 服务条款的情况下抓取 Reddit 吗?

要在不违反规则的情况下抓取 Reddit,您必须严格遵守 Reddit 的政策。 Reddit 允许您使用公共信息,但如果您使用自动抓取,请遵守他们的 API 规则。 不要走得太快,遵循限制,并牢记用户的隐私。

如果您未经许可进行抓取,尤其是金钱内容,您的帐户可能会被暂停。 阅读并遵守 Reddit 规则非常重要,确保您以良好且合法的方式获取数据。 请密切关注其规则的任何变化,以确保您在负责网络抓取的同时仍然正确行事。

如何避免在抓取 Reddit 时被屏蔽?

为了确保您在抓取 Reddit 时不会被屏蔽,只需遵循一些好习惯即可。 首先,不要同时向 Reddit 的服务器发送太多请求,保持合理。 像人一样行事,在请求之间随机休息,并且在繁忙时间不要浪费太多时间。 遵守规则,不要抓取任何私人或敏感内容。 保持你的抓取代码是最新的,以防 Reddit 发生变化。 通过负责任地抓取,您可以增加保持畅通的机会。

如何分析和可视化抓取的 Reddit 数据?

要了解从 Reddit 获得的信息,您需要执行一些步骤。 首先,将数据整齐地分组,例如帖子、评论或用户内容。 使用 Pandas 等 Python 工具来清理数据。 使用 Matplotlib 和 Seaborn 制作图表,看看发生了什么。 通过查看数字来了解趋势、热门话题或用户的参与情况。

为了捕捉内容的氛围,TextBlob 等工具可以帮助进行词云和情感分析。 使用 Plotly 通过交互式内容让您的数据看起来很酷。 简而言之,通过混合数据组织、数字内容和炫酷图片,您可以从抓取的 Reddit 信息中学到很多东西。

我可以使用网络抓取从 Reddit 中提取哪些类型的数据?

在抓取 Reddit 时,您可以从帖子、评论和用户页面中获取大量信息,以及人们喜欢或不喜欢某事物的程度。 您可以选择想要获取信息的 Reddit 子版块、时间或用户。 这有助于收集不同的详细信息,例如流行的内容、用户喜欢的内容以及社区如何互动。 请记住,在这样做的同时遵守 Reddit 规则至关重要,以保持事情公平公正。 坚持正确的做法,你就会在 Reddit 上的网络抓取中处于有利的地位。